SỬ DỤNG VẬT LÝ ĐỂ TÌM HÌNH MẪU THÔNG TIN (THEY USED PHYSICS TO FIND THE PATTERNS IN INFORMATION)

Tùng Nguyễn

Tên bài viết gốc: THEY USED PHYSICS TO FIND THE PATTERNS IN INFORMATION

Các nhà khoa học đoạt giải năm nay đã sử dụng các công cụ từ vật lý để xây dựng các phương pháp giúp đặt nền móng mạnh mẽ cho học máy. John Hopfield đã tạo ra một cấu trúc có thể lưu trữ và tái tạo thông tin. Geoffrey Hinton đã phát minh ra một phương pháp có thể tự thân nó khám phá các thuộc tính trong dữ liệu, và phương pháp này đã trở nên quan trọng đối với các mạng nơ-ron nhân tạo lớn hiện đang được sử dụng. Nhiều người đã từng trải nghiệm cách mà máy tính có thể dịch giữa các ngôn ngữ, diễn giải hình ảnh và thậm chí thực hiện các cuộc trò chuyện. Điều có lẽ ít được biết đến hơn là loại công nghệ này từ lâu đã đóng vai trò quan trọng trong nghiên cứu, bao gồm việc phân loại và phân tích một lượng lớn dữ liệu. Sự phát triển của học máy đã bùng nổ trong khoảng mười lăm đến hai mươi năm qua và sử dụng một cấu trúc được gọi là mạng nơ-ron nhân tạo. Ngày nay, khi chúng ta nói về trí tuệ nhân tạo, đây là loại công nghệ mà chúng ta đề cập đến. Mặc dù máy tính không thể suy nghĩ, nhưng hiện nay máy móc có thể bắt chước các chức năng như ghi nhớ và học tập. Các nhà khoa học đoạt giải Nobel Vật lý năm nay đã góp phần làm cho điều này trở thành hiện thực. Bằng cách sử dụng các khái niệm và phương pháp cơ bản từ vật lý, họ đã phát triển các công nghệ sử dụng cấu trúc trong mạng nơ-ron để xử lý thông tin. Học máy khác với phần mềm truyền thống, vốn hoạt động như một loại công thức. Phần mềm nhận dữ liệu, xử lý nó theo một mô tả rõ ràng và tạo ra kết quả, giống như khi ai đó thu thập nguyên liệu và làm theo công thức để tạo ra một chiếc bánh. Thay vào đó, trong học máy, máy tính học qua ví dụ, cho phép nó giải quyết các vấn đề quá mơ hồ và phức tạp để có thể xử lý bằng các hướng dẫn từng bước. Một ví dụ là diễn giải một bức ảnh để xác định các đối tượng trong đó.

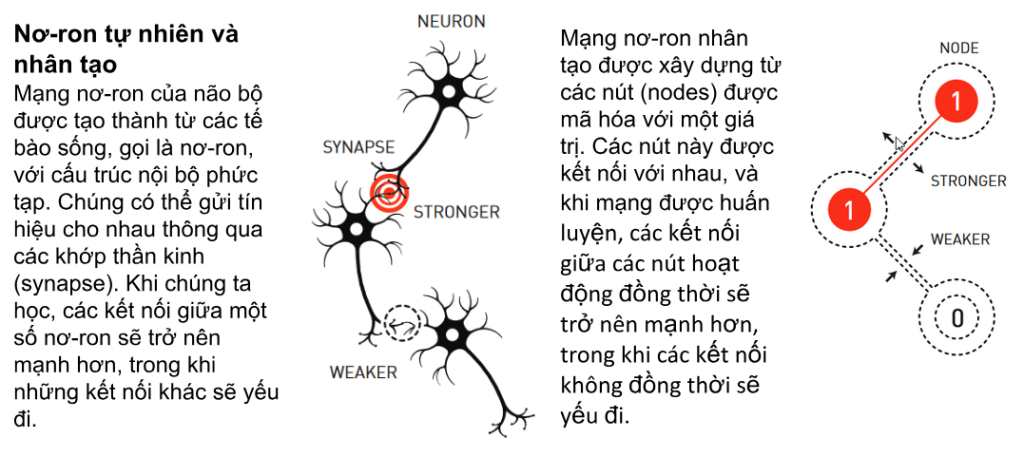

Bắt chước bộ não

Mạng nơ-ron nhân tạo xử lý thông tin bằng cách sử dụng toàn bộ cấu trúc mạng. Nguồn cảm hứng ban đầu đến từ mong muốn hiểu cách bộ não con người hoạt động. Vào những năm 1940, các nhà nghiên cứu đã bắt đầu lý luận về các phép toán học làm nền tảng cho mạng lưới tế bào thần kinh và khớp thần kinh trong não bộ. Một mảnh ghép khác của câu đố này đến từ tâm lý học, nhờ vào giả thuyết của nhà thần kinh học Donald Hebb về cách học tập xảy ra khi các kết nối giữa các tế bào thần kinh được củng cố khi chúng hoạt động cùng nhau. Sau đó, những ý tưởng này được tiếp nối bằng các nỗ lực tái tạo cách mạng lưới não bộ hoạt động thông qua việc xây dựng các mạng nơ-ron nhân tạo dưới dạng mô phỏng trên máy tính. Trong đó, các nơ-ron của não được mô phỏng bằng các nút (nodes) được gán các giá trị khác nhau, và các khớp thần kinh được biểu diễn bằng các kết nối giữa các nút, có thể được tăng cường hoặc suy yếu. Giả thuyết của Donald Hebb vẫn được sử dụng như một trong những quy tắc cơ bản để cập nhật các mạng nhân tạo thông qua một quá trình gọi là huấn luyện. Vào cuối những năm 1960, một số kết quả lý thuyết gây thất vọng đã khiến nhiều nhà nghiên cứu nghi ngờ rằng các mạng nơ-ron này sẽ không bao giờ thực sự hữu ích. Tuy nhiên, sự quan tâm đến mạng nơ-ron nhân tạo đã được khơi dậy trở lại vào những năm 1980, khi một số ý tưởng quan trọng xuất hiện, bao gồm cả công trình của những người đoạt giải năm nay.

Trí nhớ liên kết

Hãy tưởng tượng bạn đang cố gắng nhớ một từ khá hiếm gặp mà bạn ít khi sử dụng, chẳng hạn như từ chỉ sàn dốc thường thấy trong rạp chiếu phim hoặc giảng đường. Bạn tìm kiếm trong trí nhớ của mình. Đó là một cái gì đó như ramp… có lẽ là rad…ial? Không, không phải. Rake, chính là nó!. Quá trình tìm kiếm qua những từ tương tự để tìm đúng từ này gợi nhớ đến trí nhớ liên kết mà nhà vật lý John Hopfield phát hiện vào năm 1982. Mạng Hopfield có thể lưu trữ các mẫu hình và sử dụng một phương pháp để tái tạo chúng. Khi mạng được cung cấp một mẫu hình không đầy đủ hoặc bị méo mó một chút, phương pháp này có thể tìm ra mẫu đã lưu trữ tương tự nhất. Hopfield trước đó đã sử dụng nền tảng kiến thức về vật lý để khám phá các vấn đề lý thuyết trong sinh học phân tử. Khi ông được mời tham dự một hội nghị về thần kinh học, ông đã tiếp xúc với các nghiên cứu về cấu trúc của não bộ. Bị cuốn hút bởi những gì mình học được, ông bắt đầu suy nghĩ về cơ chế hoạt động của các mạng nơ-ron đơn giản. Khi các tế bào thần kinh hoạt động cùng nhau, chúng có thể tạo ra những đặc tính mới và mạnh mẽ, mà người ta không thể nhận ra nếu chỉ nhìn vào các thành phần riêng lẻ của mạng.

Năm 1980, Hopfield rời vị trí tại Đại học Princeton, nơi mà các mối quan tâm nghiên cứu của ông đã vượt ra ngoài lĩnh vực vật lý mà đồng nghiệp ông đang làm việc, và chuyển đến phía bên kia đất nước. Ông chấp nhận lời mời làm giáo sư tại Viện Công nghệ California (Caltech) ở Pasadena, miền nam California, trong lĩnh vực hóa học và sinh học. Tại đây, ông có quyền truy cập vào các tài nguyên máy tính để tự do thử nghiệm và phát triển ý tưởng của mình về mạng nơ-ron. Tuy nhiên, ông không từ bỏ nền tảng vật lý của mình, nơi ông tìm thấy nguồn cảm hứng để hiểu cách các hệ thống với nhiều thành phần nhỏ cùng làm việc có thể tạo ra những hiện tượng mới và thú vị. Đặc biệt, ông đã hưởng lợi từ việc học về các vật liệu từ tính có những đặc tính đặc biệt nhờ vào spin nguyên tử – một thuộc tính khiến mỗi nguyên tử trở thành một nam châm nhỏ. Spin của các nguyên tử lân cận ảnh hưởng lẫn nhau; điều này có thể cho phép hình thành các miền (domains) với spin theo cùng một hướng. Sử dụng vật lý mô tả cách các vật liệu phát triển khi spin ảnh hưởng lẫn nhau, ông đã tạo ra được một mạng mô hình với các nút và kết nối.

Mạng lưu trữ hình ảnh trong không gian

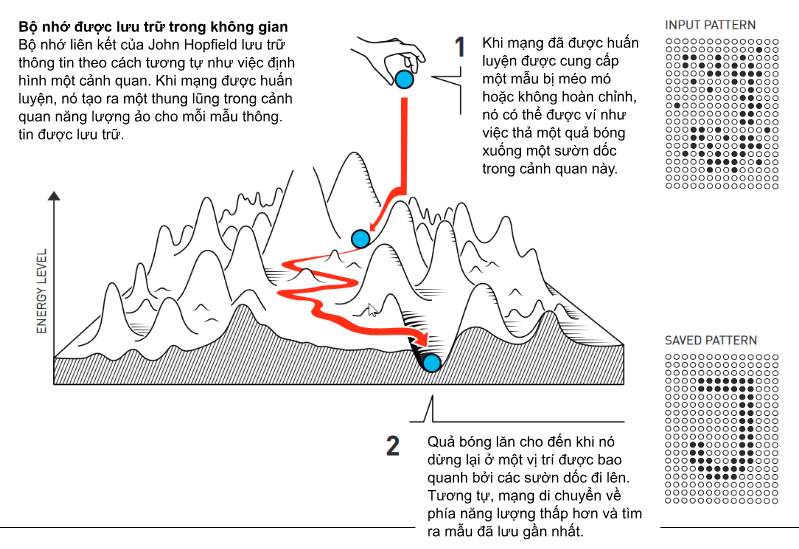

Mạng mà Hopfield xây dựng có các nút (nodes) được kết nối với nhau bằng các liên kết có độ mạnh yếu khác nhau. Mỗi nút có thể lưu trữ một giá trị riêng lẻ – trong công trình đầu tiên của Hopfield, giá trị này có thể là 0 hoặc 1, giống như các pixel trong một bức ảnh đen trắng. Hopfield mô tả trạng thái tổng thể của mạng bằng một thuộc tính tương đương với năng lượng trong hệ spin được tìm thấy trong vật lý; năng lượng này được tính toán bằng một công thức sử dụng tất cả các giá trị của các nút và tất cả các độ mạnh của liên kết giữa chúng. Mạng Hopfield được lập trình bằng cách nạp một hình ảnh vào các nút, được gán giá trị đen (0) hoặc trắng (1). Các liên kết trong mạng sau đó được điều chỉnh dựa trên công thức năng lượng, sao cho hình ảnh được lưu trữ có năng lượng thấp nhất. Khi một mẫu hình khác được đưa vào mạng, có một quy tắc để lần lượt kiểm tra các nút, xem liệu năng lượng của mạng có giảm đi hay không nếu giá trị của nút đó được thay đổi. Nếu phát hiện rằng năng lượng giảm khi một pixel đen chuyển thành trắng, nó sẽ thay đổi màu sắc. Quá trình này tiếp tục cho đến khi không thể tìm thêm cách nào để giảm năng lượng nữa. Khi đạt đến điểm này, mạng thường tái tạo lại hình ảnh gốc mà nó đã được huấn luyện.

Điều này có vẻ không quá ấn tượng nếu bạn chỉ lưu một mẫu hình duy nhất. Có lẽ bạn đang tự hỏi tại sao không chỉ đơn giản là lưu hình ảnh đó và so sánh nó với một hình ảnh khác được thử nghiệm. Nhưng phương pháp của Hopfield đặc biệt vì nó có thể lưu nhiều hình ảnh cùng lúc và mạng có khả năng phân biệt giữa chúng. Hopfield ví việc tìm kiếm trạng thái đã lưu trong mạng giống như việc lăn một quả bóng qua một không gian với các đỉnh và vùng trũng, có ma sát làm chậm chuyển động của nó. Nếu quả bóng được thả ở một vị trí cụ thể, nó sẽ lăn vào vùng trũng gần nhất và dừng lại ở đó. Tương tự, nếu mạng được cung cấp một mẫu hình gần với một trong các mẫu đã lưu, nó sẽ tiếp tục di chuyển cho đến khi kết thúc ở đáy của một vùng trũng trong không gian năng lượng, từ đó tìm ra mẫu gần nhất trong trí nhớ của nó.

Mạng Hopfield có thể được sử dụng để tái tạo dữ liệu chứa nhiễu hoặc đã bị xóa một phần. Hopfield và các nhà nghiên cứu khác đã tiếp tục phát triển chi tiết về cách mạng Hopfield hoạt động, bao gồm việc cho phép các nút lưu trữ bất kỳ giá trị nào, không chỉ là 0 hoặc 1. Nếu bạn hình dung các nút như các pixel trong một bức ảnh, chúng có thể có nhiều màu sắc khác nhau, không chỉ đen hoặc trắng. Các phương pháp cải tiến đã giúp khả năng lưu trữ nhiều hình ảnh hơn và phân biệt giữa chúng ngay cả khi chúng khá giống nhau. Điều này cũng có thể áp dụng để nhận dạng hoặc tái tạo bất kỳ loại thông tin nào, miễn là thông tin đó được xây dựng từ nhiều điểm dữ liệu.

Phân loại dựa trên vật lý thế kỷ 19

Nhớ lại một hình ảnh là một chuyện, nhưng diễn giải nó miêu tả điều gì lại cần thêm một chút nỗ lực. Ngay cả trẻ nhỏ cũng có thể chỉ vào các con vật khác nhau và tự tin nói liệu đó là chó, mèo hay sóc. Chúng có thể thỉnh thoảng nhầm lẫn, nhưng khá nhanh chóng, chúng sẽ nhận biết đúng gần như mọi lúc. Một đứa trẻ có thể học điều này ngay cả khi không cần xem các biểu đồ hay giải thích về các khái niệm như loài hoặc động vật có vú. Sau khi tiếp xúc với một vài ví dụ của mỗi loại động vật, các loại khác nhau sẽ tự sắp xếp vào bộ nhớ trong đầu của trẻ. Con người học cách nhận ra một con mèo, hiểu một từ, hoặc bước vào một căn phòng và nhận thấy điều gì đó đã thay đổi, thông qua việc trải nghiệm môi trường xung quanh họ. Khi Hopfield công bố bài báo của mình về trí nhớ liên kết, Geoffrey Hinton đang làm việc tại Đại học Carnegie Mellon ở Pittsburgh, Hoa Kỳ. Trước đó, ông đã học tâm lý học thực nghiệm và trí tuệ nhân tạo ở Anh và Scotland, đồng thời suy nghĩ liệu máy móc có thể học cách xử lý các mẫu hình theo cách tương tự như con người, tự tìm ra các loại riêng để phân loại và diễn giải thông tin. Cùng với đồng nghiệp Terrence Sejnowski, Hinton bắt đầu từ mạng Hopfield và mở rộng nó để xây dựng một thứ hoàn toàn mới, sử dụng các ý tưởng từ vật lý thống kê.

Vật lý thống kê mô tả các hệ thống được cấu thành từ nhiều phần tử tương tự nhau, chẳng hạn như các phân tử trong một chất khí. Việc theo dõi tất cả các phân tử riêng lẻ trong chất khí là khó khăn, hoặc không thể, nhưng có thể xem xét chúng như một tập hợp để xác định các đặc tính tổng quát của chất khí như áp suất hoặc nhiệt độ. Có rất nhiều cách các phân tử khí có thể phân bố trong không gian ở các tốc độ riêng lẻ khác nhau mà vẫn dẫn đến cùng một đặc tính tổng thể. Các trạng thái mà các thành phần riêng lẻ có thể cùng tồn tại có thể được phân tích bằng vật lý thống kê, và xác suất của chúng có thể được tính toán. Một số trạng thái có xác suất xảy ra cao hơn những trạng thái khác; điều này phụ thuộc vào lượng năng lượng có sẵn, được mô tả trong một phương trình của nhà vật lý thế kỷ 19 Ludwig Boltzmann. Mạng của Hinton đã sử dụng phương trình này, và phương pháp này được công bố vào năm 1985 với cái tên nổi bật: Máy Boltzmann (Boltzmann Machine).

Nhận diện các mẫu mới thuộc cùng một loại

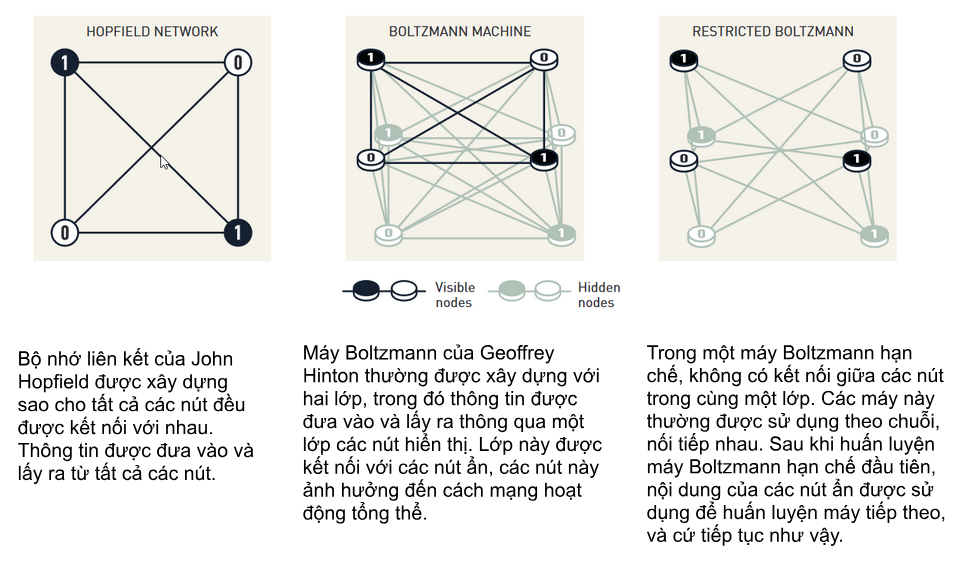

Máy Boltzmann thường được sử dụng với hai loại nút khác nhau. Một nhóm, gọi là các nút hiển thị (visible nodes), được sử dụng để nhận thông tin đầu vào. Nhóm còn lại tạo thành một lớp ẩn (hidden layer). Giá trị của các nút ẩn và các kết nối giữa chúng cũng đóng góp vào năng lượng của toàn bộ mạng. Máy được vận hành bằng cách áp dụng một quy tắc để cập nhật giá trị của từng nút một lần lượt. Cuối cùng, máy sẽ đạt đến trạng thái mà mô hình của các nút có thể thay đổi, nhưng các đặc tính của mạng tổng thể vẫn giữ nguyên. Mỗi mô hình có thể xảy ra sẽ có một xác suất cụ thể được xác định bởi năng lượng của mạng, theo phương trình của Boltzmann. Khi máy dừng hoạt động, nó đã tạo ra một mô hình mới, điều này khiến Máy Boltzmann trở thành một trong những ví dụ sớm về mô hình tạo sinh (Generative model).

Các loại mạng khác nhau

Máy Boltzmann có thể học – không phải từ hướng dẫn, mà từ các ví dụ được cung cấp. Nó được huấn luyện bằng cách cập nhật các giá trị trong các liên kết của mạng sao cho các mẫu hình ví dụ, được nạp vào các nút hiển thị trong quá trình huấn luyện, có xác suất xảy ra cao nhất khi máy hoạt động. Nếu một mẫu hình được lặp lại nhiều lần trong quá trình huấn luyện, xác suất của mẫu hình này càng cao hơn. Việc huấn luyện cũng ảnh hưởng đến xác suất tạo ra các mẫu mới tương tự với các ví dụ mà máy đã được huấn luyện. Một máy Boltzmann đã được huấn luyện có thể nhận ra các đặc điểm quen thuộc trong thông tin mà nó chưa từng thấy trước đây. Hãy tưởng tượng bạn gặp anh chị em của một người bạn và ngay lập tức nhận ra rằng họ chắc chắn có quan hệ họ hàng. Tương tự, máy Boltzmann có thể nhận ra một ví dụ hoàn toàn mới nếu nó thuộc về một danh mục đã có trong tài liệu huấn luyện và phân biệt nó với những thứ không tương đồng. Ở dạng nguyên bản, máy Boltzmann khá kém hiệu quả và mất nhiều thời gian để tìm ra giải pháp. Tuy nhiên, mọi thứ trở nên thú vị hơn khi máy được phát triển theo nhiều cách khác nhau, điều mà Hinton đã tiếp tục nghiên cứu. Các phiên bản sau này đã được đơn giản hóa, bằng cách loại bỏ một số liên kết giữa các đơn vị. Điều đáng ngạc nhiên là điều này có thể làm cho máy trở nên hiệu quả hơn.

Trong những năm 1990, nhiều nhà nghiên cứu mất hứng thú với mạng nơ-ron nhân tạo, nhưng Hinton là một trong số ít người tiếp tục làm việc trong lĩnh vực này. Ông cũng góp phần khởi xướng làn sóng bùng nổ kết quả thú vị mới; vào năm 2006, ông cùng các đồng nghiệp Simon Osindero, Yee Whye Teh và Ruslan Salakhutdinov phát triển một phương pháp tiền huấn luyện mạng bằng một loạt máy Boltzmann theo từng lớp, chồng lên nhau. Phương pháp tiền huấn luyện này cung cấp cho các liên kết trong mạng một điểm khởi đầu tốt hơn, tối ưu hóa quá trình huấn luyện để nhận diện các thành phần trong hình ảnh. Máy Boltzmann thường được sử dụng như một phần của một mạng lớn hơn. Ví dụ, nó có thể được dùng để đề xuất phim hoặc chương trình truyền hình dựa trên sở thích của người xem.

Học máy – hiện tại và tương lai

Nhờ vào công trình của John Hopfield và Geoffrey Hinton từ những năm 1980 trở đi, họ đã góp phần đặt nền móng cho cuộc cách mạng học máy bắt đầu từ khoảng năm 2010. Sự phát triển mà chúng ta đang chứng kiến hiện nay đã trở thành khả thi nhờ vào việc có thể tiếp cận với lượng dữ liệu khổng lồ để huấn luyện các mạng lưới, cùng với sự gia tăng mạnh mẽ về sức mạnh tính toán. Các mạng nơ-ron nhân tạo ngày nay thường rất lớn và được xây dựng từ nhiều lớp. Những mạng này được gọi là mạng nơ-ron sâu (Deep neural networks) và cách chúng được huấn luyện được gọi là học sâu (Deep learning). Một cái nhìn nhanh về bài báo của Hopfield về trí nhớ liên kết, từ năm 1982, sẽ giúp chúng ta có cái nhìn rõ hơn về sự phát triển này. Trong bài báo đó, ông sử dụng một mạng gồm 30 nút. Nếu tất cả các nút đều kết nối với nhau, sẽ có 435 kết nối. Các nút có giá trị của chúng, các kết nối có độ mạnh khác nhau và tổng cộng, có ít hơn 500 tham số cần theo dõi. Ông cũng thử nghiệm một mạng với 100 nút, nhưng điều này quá phức tạp so với máy tính mà ông sử dụng lúc đó. Chúng ta có thể so sánh điều này với các mô hình ngôn ngữ lớn ngày nay, được xây dựng như những mạng có thể chứa hơn một nghìn tỷ tham số (một triệu triệu). Nhiều nhà nghiên cứu hiện nay đang phát triển các ứng dụng của học máy. Điều nào sẽ khả thi nhất vẫn còn phải chờ xem, trong khi có những cuộc thảo luận rộng rãi về các vấn đề đạo đức xung quanh việc phát triển và sử dụng công nghệ này.

Vì vật lý đã đóng góp các công cụ cho sự phát triển của học máy, nên thật thú vị khi thấy rằng vật lý, như một lĩnh vực nghiên cứu, cũng đang hưởng lợi từ các mạng nơ-ron nhân tạo. Học máy đã được sử dụng trong nhiều lĩnh vực mà chúng ta có thể quen thuộc từ những giải Nobel Vật lý trước đây. Những ứng dụng này bao gồm việc sử dụng học máy để lọc và xử lý lượng dữ liệu khổng lồ cần thiết để phát hiện hạt Higgs. Các ứng dụng khác bao gồm giảm nhiễu trong các phép đo sóng hấp dẫn từ các lỗ đen va chạm, hoặc tìm kiếm các ngoại hành tinh. Trong những năm gần đây, công nghệ này cũng bắt đầu được sử dụng khi tính toán và dự đoán các đặc tính của phân tử và vật liệu – chẳng hạn như tính toán cấu trúc của phân tử protein, điều này quyết định chức năng của chúng, hoặc tìm ra phiên bản mới của một vật liệu có thể có những đặc tính tốt nhất để sử dụng trong các tế bào quang điện hiệu quả hơn.

ĐỌC THÊM

Thông tin bổ sung về các giải thưởng năm nay, bao gồm nền tảng khoa học bằng tiếng Anh, có sẵn trên trang web của Viện Hàn lâm Khoa học Hoàng gia Thụy Điển, www.kva.se, và tại www.nobelprize.org, nơi bạn có thể xem video từ các buổi họp báo, các bài giảng Nobel và nhiều nội dung khác. Thông tin về các triển lãm và hoạt động liên quan đến Giải Nobel và Giải Nobel Kinh tế có sẵn tại www.nobelprizemuseum.se.

Viện Hàn lâm Khoa học Hoàng gia Thụy Điển đã quyết định trao Giải Nobel Vật lý năm 2024 cho…

“Vì những phát hiện và phát minh nền tảng cho phép máy học với các mạng nơ-ron nhân tạo”.